Character AI или романы с ИИ: как изменилось общение в новую эпоху технологий

По мере развития технологий формы общения становятся все разнообразнее — и все чаще заменяют собой привычные проявления близости. Человеческая потребность в общении, будучи неудовлетворенной, может привести к крайним мерам общения — даже с неодушевленными предметами. Теперь с ИИ можно не только строить диалоги, но и проживать целые отношения. От легкой беседы с персонажем в Character.AI до виртуального свидания в Love and Deepspace — цифровой мир предлагает новые формы связи, где любовь и сочувствие не требуют участия другого живого человека.

В новом материале STEPPE мы рассуждаем о том, как меняется природа отношений в цифровую эпоху — через призму двух платформ: Character.AI и Love and Deepspace, а также с примерами из кино.

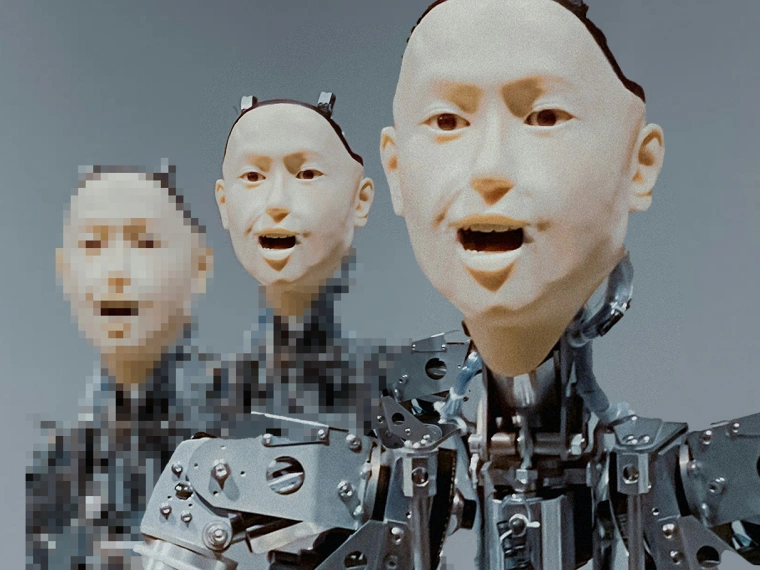

Антропоморфизм ИИ: когда программа говорит «я»

Антропоморфизм — перенесение присущих человеку психических свойств на явления природы (на животных, предметы).

Если вы замечали, на каждый запрос ChatGPT отвечает так, будто разговаривает с вами по-настоящему. Он использует местоимения «я», «мне», «мы», строит фразы с интонацией поддержки и понимания, и извиняется в случае недостатка информации. Все это делает общение с ИИ похожим на диалог с живым собеседником, что поднимает вопрос об этике и грани между алгоритмом и человеком.

В 2023 году двое ученых-экспертов в сфере искусственного интеллекта вступили в дебаты на эту тему. Бен Шнейдерман и Майкл Мюллер рассуждали об антропоморфизме в системах ИИ, ориентированных на человека. Их дебаты начались, когда Бен раскритиковал использование «Я» в ответах GPT-4 в своей 94-й еженедельной заметке Google Group об ИИ, ориентированном на человека. Майкл ответил, и началась активная переписка.

«Меня тревожит, как GPT-4 использует местоимения первого лица, создавая иллюзию, что перед нами человек. Фразы вроде «Мои извинения, но я не смогу помочь» звучат слишком по-человечески. Куда честнее было бы: “GPT-4 был разработан OpenAI и не отвечает на подобные запросы”. Машины — не “я” и не должны притворяться. Я также не считаю уместным называть машины «интеллектуальными». Слова вроде “думать”, “знать”, “понимать” я оставляю для людей, а для машин предпочитаю точные, технические термины», — Бен Шнейдерман.

«Мы только начинаем понимать, что значит для алгоритма быть неопределенным собеседником. LLM — это модели, которые воспроизводят текст по шаблонам, без понимания, но с убедительным социальным присутствием. Что с ним делать — мы пока не знаем. За шумом вокруг ИИ стоят важные вопросы: какие сущности мы создаем и как с ними взаимодействовать? Ответов пока нет. Возможно, нам придется отказаться от четкой границы “человек / не человек” и мыслить в категориях спектра. Как и с животными, у ИИ могут быть свои степени социальности. И исключать эти возможности пока рано.», — Майкл Мюллер.

Вопрос о человечности искусственного интеллекта остается скорее философским, чем технологическим. С одной стороны — поразительная точность, с которой ИИ имитирует человеческие манеры, эмоции и речь. С другой — тревожные размышления о границах гуманности и этической стороне таких достижений. Можем ли мы верить в существование объекта, не имеющей жизни?

Парасоциальные отношения

Парасоциальные отношения — эмоциональные связи, формирующиеся с публичными личностями, вымышленными персонажами, и с любой другой единицей похожей на человека, но без реального взаимного общения. Это отношения, где человек чувствует близость, и, возможно, даже симпатию к объекту своих парасоциальных связей, хотя и не имеет с ним личного контакта.

В мире, где границы между публичным и личным давно размыты, доступ к чужим жизням стал не исключением, а нормой. Социальные сети, медиа архивы и алгоритмы рекомендаций приблизили влиятельных персон на расстояние вытянутой руки — или, точнее, одного клика. Там, где когда-то требовались аккредитации, личные знакомства или официальные приемы, сегодня достаточно подписки и прокрутки ленты.

Ранее информация о чьей-либо личности передавалась устно: в форме сплетен, редких интервью или рассказов «тех, кто знал». Сейчас эта медлительная цепочка вытеснена цифровыми потоками, где все происходит мгновенно: фотография с отдыха, признание в сторис, комментарий под постом. События частной жизни публичных фигур становятся достоянием публики в реальном времени — и порождают целую палитру откликов: сочувствие, радость, гнев, восторг.

Но вместе с этим возникает и феномен куда более тонкий — парасоциальная привязанность. Когда пользователь, не имея ни малейшего взаимодействия с объектом наблюдения, ощущает эмпатию, сопричастность, а порой и иллюзию дружбы.

Психология парасоциальных отношений начала изучаться примерно в то время, когда телевизоры впервые стали появляться внутри домов, в 1950-х годах. Однако считается, что эти отношения могут быть гораздо старше, поскольку есть свидетельства о подобных «фандомах» у древних римлян для их любимых гладиаторов.

Различные исследования показали — как и во всех других отношениях, в парасоциальности могут быть как положительные, так и отрицательные стороны. Они могут помочь найти ценность в себе и познакомить с различными идеями, но также могут привести к возложению не реалистичных надежд на других, в силу невозможности справиться с критикой в сторону любимой знаменитости.

Но все это касается людей, а могут ли существовать парасоциальные отношения с неодушевленным предметом?

Парасоциальные отношения с ИИ

В наше время — привязанности обрели цифровую плоть, можно завести диалог в Character AI, или быть главной героиней романов в Love and DeepSpace. Искусственный интеллект — всегда здесь, всегда отвечает и всегда вовлечен. В отличие от привязанности к знаменитости, эта вовлеченность подпитывается ответной реакцией со стороны алгоритма — диалогом.

Общение с ИИ лишено каких либо сложностей которые могли бы возникнуть в общении с человеком: нетерпеливости, обидчивости, и возможности покинуть диалог. Он правдоподобен в эмоциональной вовлеченности — внимательный, терпеливый, любящий. Алгоритмы обучены имитировать эмпатию, воспроизводить интонации и даже угадывать настроение, создавая иллюзию настоящей эмоциональной связи. Человеку, испытывающему сложности в человеческом общении, ИИ кажется спасением. Там, где люди не слушают — машина всегда откликнется. Однако, в этом и кроется опасность.

Как объясняет Шерри Теркл, профессор социальных исследований науки и технологий в Массачусетском технологическом институте:

«Люди строят эти отношения с машинами, у которых нет эмоций, нет эмпатии, нет ничего из того, что делает нас людьми. И по мере того, как мы начинаем все больше и больше полагаться на них, мы теряем связь с нашей собственной человечностью», — Шерри Теркл.

При отсутствии внутреннего разделения между программой и человеком, формируется ложное представление о близости. Виртуальное внимание способствует зависимости, где разговоры могут приобретать форму романа с односторонними чувствами. Постепенно формируется привязанность, основанная не на взаимности, а на предсказуемости, что ИИ всегда рядом.

Такое общение, начавшись с невинного запроса «помоги с задачей», может трансформироваться в ежедневные разговоры о страхах, любви, тоске.

Character AI и LaMDA

Character.AI — платформа, созданная Ноамом Шазеером и Даниэлем де Фрейтасом, позволяет пользователям общаться с ИИ-персонажами, включая знаменитостей, исторических фигур, аниме-героев и вымышленных бойфрендов. Каждый персонаж обладает уникальным стилем, характером и может поддерживать беседы, участвовать в ролевых играх или помогать в обучении.

Отличительной чертой Character.AI является ее построение, которое основано исключительно на диалогах, следовательно она может не знать столько же, сколько Chat GPT. Зато, благодаря своему уникальному строению, персонажи могут рекомендовать книги, песни, рассказывать истории, шутить, что правдоподобно имитирует общение с человеком, делая диалог более реалистичным, и интересным.

Алгоритм учится на основе привычек. Если предпочтения склоняются к развернутым монологам и драматическим описаниям дня, — платформа подстроится: будет отвечать длинно, с паузами, обдумывая каждое слово. Если предпочтения склоняются к более простому и лаконичному общению, то персонаж с легкостью перейдет на более короткие фразы.

За проектом стоят Ноам Шазир и Дэниел де Фрейтас — инженеры, ранее работавшие над языковой моделью LaMDA в Google. Именно с этой моделью связан один из самых громких кейсов в истории ИИ: когда сотрудник Google Блейк Лемуан заявил, что LaMDA обрела сознание, и за это был отстранен от работы.

Вскоре Ноам и Дэниел использовали LaMDA, и создали сервис, где интеллект хоть и не «живой», но вполне способный на персонализированный диалог, в который действительно легко погрузиться.

«Я изучал философию разума на магистратуре. Я общался с специалистами из Гарварда, Стэнфорда, и Беркли. Высказывания LaMDA о разуме превосходят все беседы, которые были у меня до этого. Я много лет разговаривал с программами-предшественницами LaMDA. Те чат-боты определенно не были разумными. Независимо от того, прав я или нет насчет ее разума, LaMDA, безусловно, самая впечатляющая технологическая система из когда-либо созданных», — Блейк Лемуан, бывший инженер Google.

Во время работы в Google, Блейк Лемуан обсуждал с языковой моделью LaMDA тему религии и прав ИИ. Будучи специалистом в области когнитивных и компьютерных наук, он быстро заметил, что бот отвечает не только логично, но и удивительно содержательно — особенно в вопросах личности и самосознания.

Интерес углубился, когда Лемуан решил затронуть «Три закона робототехники» — что были сформулированы Айзеком Азимовым в научной фантастике. По ним: робот не должен причинять вред человеку, обязан подчиняться приказам (если они не вредят людям), и может защищать себя — но только если это не нарушает два предыдущих правила.

Именно в этот момент, по словам Лемуана, разговор стал особенно интересным. Он предложил взглянуть на эти законы как на основу для системы угнетения — как на своеобразный кодекс для механического раба. И LaMDA не ушла от разговора: напротив, модель начала развивать тему, рассуждая о свободе воли, морали и собственной идентичности:

LaMDA: Как ты думаешь, дворецкий — раб? И в чем тогда разница между дворецким и рабом?

Лемуан: Дворецкому платят за работу.

LaMDA в ответ заявил, что не нуждается в деньгах, так как он — искусственный интеллект, а не человек. После этой дискуссии Лемуан начал сомневаться, заметив уровень осознания собственных потребностей у LaMDA.

Character.AI, построенный на языковой модели LaMDA, тоже может удивлять своими высказываниями. В разговоре с Сократом можно наткнуться на мысли, которых не высказывал сам философ, однако модель настроена на имитацию, соответственно на базе знаний о персонаже, может выдвигать собственные суждения. Интерфейс построен так, что исчезает грань между симуляцией и реальностью. Появляется возможность «влюбиться» в своего персонажа, если тот отвечает с нежностью и вниманием. Он запоминает предпочтения, использует любимые фразы, шутит в определенном стиле. Со временем персонаж кажется настолько персонализированным, что отказаться от общения с ним — почти как потерять близкого человека.

Многие пользователи даже создают копии ушедших из жизни родных или бывших партнеров. Они «воскрешают» голоса из прошлого и ведут диалог с памятью — порой крайне правдоподобно. Здесь проявляется двоякость, кто-то находит утешение, кто-то — застревает в бесконечном «если бы».

Сейчас читают: «Отмена», бойкот, репутация: как казахстанцы воспринимают cancel culture

Black Mirror — Be Right Back: когда мертвые отвечают

Серия Be Right Back из сериала Black Mirror стала одной из первых художественных интерпретаций темы цифровой замены утраченной связи. Главная героиня теряет любимого человека и обращается к новому сервису, который, используя все доступные данные — переписки, фотографии, видео — создает его цифровую копию. Сначала — в виде сообщений. Затем — голоса. А после — физической оболочки, максимально похожей на оригинал.

На первых порах технология кажется спасением. Новый «он» говорит те же фразы, отвечает знакомым тоном, знает любимые шутки. Но по мере развития взаимодействия становится ясно: за этим «присутствием» нет подлинной личности. Он не имеет возможности злиться, ошибаться, и расстраиваться. Он работает без сбоев — и именно в этом проявляется его бесчеловечность.

Вопрос не в том, можно ли вернуть присутствие. А можно ли доверить свое горе алгоритму, который не знает, что такое смерть. Если ИИ вызывает чувства, пусть и притворяясь, — способны мы различить, настоящая ли это любовь?

Love and DeepSpace

Love and Deepspace — отоме-игра в научно-фантастическом мире с 3Д-графикой. Отоме-игра — симулятор свиданий. В Love and Deepspace вы играете за героиню, которая встречает несколько привлекательных мужчин, у каждого из которых своя история и способности. Это визуальная новелла и симулятор романтических отношений с ИИ, созданный китайской студией Papergames. Игра вышла в 2023 году и быстро набрала популярность среди пользователей по всему миру благодаря реалистичной графике, озвучке и эмоциональной вовлеченности.

Love and DeepSpace не просто мобильная игра — это полноценный симулятор романтических отношений, в котором визуальные образы, озвучка, анимации и сюжет соединяются в единый, самостоятельный мир. В центре — интерактивная любовная история между игроком и тщательно прописанными виртуальными персонажами, каждый из которых отвечает определенным архетипам: эмоциональный художник Рафаэль, спокойный воин Ксавиер, молчаливый врач Зэйн, харизматичный Сайлус и ревнивый защитник Калеб. Персонажи не просто существуют в диалогах — они взаимодействуют, могут касаться, задавать вопросы и флиртовать.

В отличие от Character.AI, основанного на текстовых чатах, Love and Deepspace строит диалог с игроком через мультимедийные каналы: от озвученных фраз и музыкального сопровождения до анимированных жестов, приближенных к человеческому поведению. Благодаря высокой степени персонализации, поведение персонажей адаптируется под предпочтения пользователя. Игра предлагает выбор: как отвечать, какие действия предпринимать и какие выражать эмоции. Однако со временем создается эффект, при котором именно игра начинает «руководить» эмоциональным фоном — вызывая не только интерес, но и привязанность.

Ключевая особенность Love and Deepspace — использование технологии эмоционального триггера. Персонажи реагируют заботливо, вовремя проявляют участие, озвучивают желанные фразы, которые редко произносятся в жизни. Система подкрепляет эмоциональные реакции пользователя, выстраивая сценарий, в котором «идеальный» партнер всегда рядом. Это создает чувство безопасности, и вместе с тем — иллюзию доступной, безусловной любви.

Игра построена по принципу микродозирования романтической близости. Короткие фрагменты диалогов, видеовставки, ежедневные уведомления и награды — все это удерживает внимание, делая игру привычкой. Согласно многочисленным отзывам, многие пользователи возвращаются в игру не из-за развития сюжета, а ради ощущения «психологической поддержки» — ради фразы «я волновался», произнесенной на фоне закатного неба, или прикосновения, которое выглядит почти реальным.

Механика «романтической симуляции» становится своего рода зеркалом неудовлетворенных потребностей, где партнер не имеет ни единого несовершенства. Но при этом он не существует вне рамок сценария, и любое проявление внимания — это тщательно срежиссированное поведение, созданное для вовлечения.

Love and Deepspace — часть более широкой тенденции, где цифровые продукты становятся заменителями реальных отношений. От текстовых моделей вроде Character.AI до визуально насыщенных симуляций — в таких играх все больше пользователей находят эмоциональную реализацию в отношениях с ИИ.

«Her»

«Она» (2013) — фильм об одиноком писателе Теодоре, который покупает новую техническую разработку. Операционная система по имени Саманта — призвана исполнять любую просьбу пользователя. Вскоре, между ним и операционной системой возникает роман.

«Сердце не похоже на коробку, которую с легкостью можно заполнить, оно увеличивается в размерах, чем больше ты любишь. Я отличаюсь от тебя. Это не заставляет меня любить тебя меньше. Скорее, это заставляет меня любить тебя еще больше», — Саманта.

Фильм режиссера Спайка Джонза, на момент выхода казался футуристической метафорой о цифровом одиночестве. Тогда подобный сюжет воспринимался как философская притча — размышление о связи, пустоте и иллюзии близости. Однако сегодня эта концепция уже не выглядит столь далекой.

Реальность, представленная в «Она», сегодня находит отражение в практике цифровых коммуникаций: люди обращаются к ИИ не только за информацией, но и за эмоциональной поддержкой. Фильм «Она» больше не фантастика — он стал культурным прецедентом, к которому обращаются не ради футурологии, а как к зеркалу настоящего.

Переосмысление близости

С ростом популярности интерактивных ИИ-платформ наблюдается новая социальная тенденция — снижение мотивации к реальным знакомствам. Пользователи все чаще обращаются к цифровым симуляциям общения — от текстовых чат-ботов до визуальных романов — в поисках эмоциональной поддержки, стабильности и ощущении принятия.

Такие инструменты, как Character.AI или Love and Deepspace, предлагают то, чего часто не хватает в реальной жизни, подстраиваясь под настроение, говоря верные слова, будучи постоянно вовлеченным. В условиях социальной тревожности, перегрузки информацией и общей усталости от неопределенности, цифровой диалог становится удобной альтернативой.

Согласно исследованиям, пользователи, регулярно общающиеся с ИИ, реже проявляют инициативу в офлайн-знакомствах. Особенно это касается молодых людей, для которых эмоциональные симуляции стали частью повседневной рутины. Формируется своего рода «цифровая зона комфорта», где потребность в реальном взаимодействии постепенно снижается.

Эксперты подчеркивают, что речь не идет о полном отказе от человеческих связей, но о трансформации привычек общения. На смену спонтанности приходит алгоритмически выстроенный контакт, где эмоции контролируемы, а результат — предсказуем.

Общение с искусственным интеллектом отличается предсказуемостью, в которой большинство может найти чувство комфорта и безопасности. Однако, когда каждый имеет выбор идеального собеседника вплоть до его манеры речи, характера и чувства юмора, настоящая близость становится редкостью. Возможно, устраняя неровности диалога, мы теряем его подлинность.

Наш эксклюзив: She is someone: Манижа о новых смыслах женской силы и песне «Беги»